Come riconoscere un video AI: 5 trucchi per smascherare l’inganno

L’AI crea video incredibilmente realistici, ma lascia sempre dettagli che tradiscono l’inganno. Ecco i 5 segnali principali da osservare

18 Novembre 2025

In questi giorni è quasi inevitabile imbattersi in video che ci lasciano a bocca aperta, per poi scoprire che si tratta di abilissimi trucchi dell’AI. Ma come difendersi da questa ondata di contenuti iper-realistici, spesso chiamati deepfake?

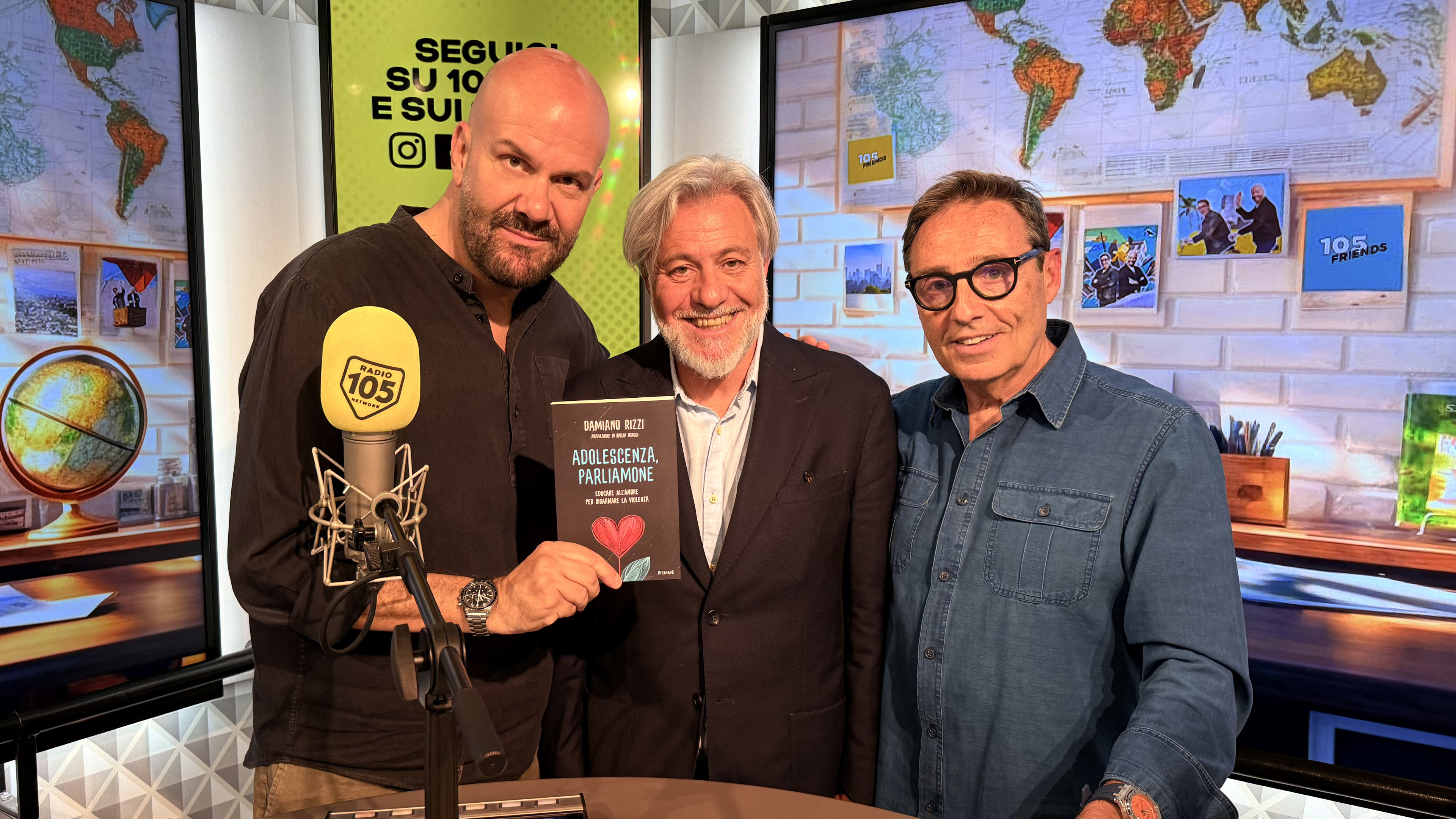

Fortunatamente, anche l’AI più avanzata commette ancora errori: piccoli difetti che ne tradiscono l’origine digitale. Pier Luigi Pisa, esperto di intelligenza artificiale, ha condiviso con Agi cinque punti critici da osservare. Ecco quali sono:

1. L’indizio fondamentale: chi pubblica il contenuto?

L’indizio più immediato non riguarda la tecnologia, ma il buon senso: chi ha diffuso il video?

Se la fonte non è una testata affidabile, una pagina verificata o una persona nota per la sua credibilità, il contenuto è sospetto. Senza una fonte autorevole, il video rischia di essere falso.

2. Lo sfondo

L’intelligenza artificiale si concentra sempre sull’elemento principale del video, trascurando lo sfondo e i dettagli secondari. Per smascherare l’inganno, osserva il soggetto: se sembra reale, controlla attentamente ciò che lo circonda. Occhio a oggetti deformati, contorni sfocati o figure sovrapposte in modo strano.

3. Lo skyline e l’architettura urbana

Se il video mostra una città riconoscibile, fai attenzione agli edifici e al paesaggio urbano. L’AI fatica a ricreare strutture complesse e iconiche, e può commettere errori evidenti. Spesso gli edifici appaiono fuori posto o addirittura “migrano” da una città all’altra: chi conosce il luogo noterà subito l’artificio.

4. Movimenti ripetitivi e poco naturali

L’AI spesso ha difficoltà a riprodurre correttamente movimenti complessi e dinamiche fisiche naturali. Le azioni generate possono apparire rigide, innaturali o addirittura andare contro le leggi della natura a cui siamo abituati.

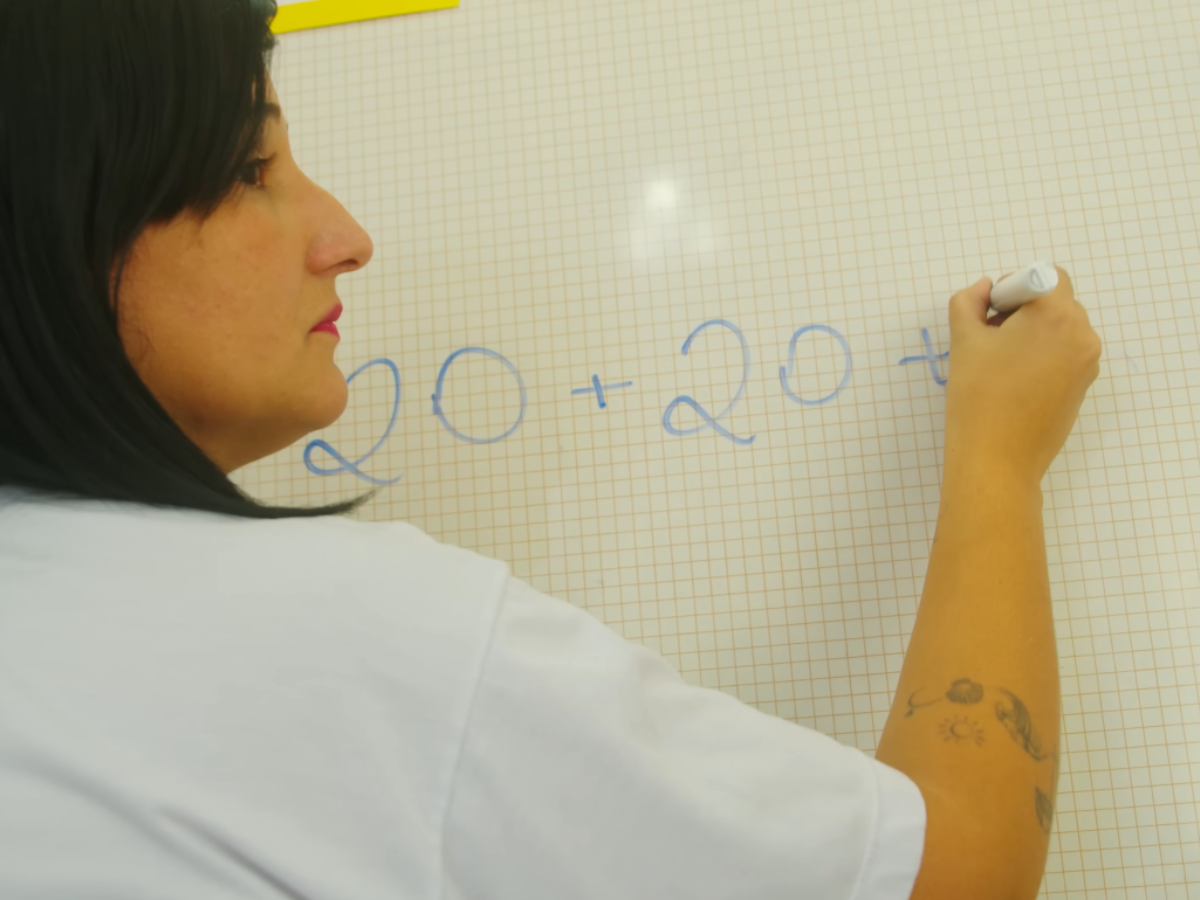

5. Loghi e scritte: l’AI e gli errori di stampa

La scrittura è uno dei punti deboli dell’Intelligenza Artificiale. Anche se riesce a generare testi complessi, inciampa spesso su scritte su cartelli, vestiti o confezioni.

Il segnale rivelatore: refusi evidenti, lettere aggiunte o marchi famosi riprodotti male. I loghi, inoltre, appaiono spesso distorti o poco fedeli all’originale. Qualsiasi testo visibile nel video può tradire l’inganno.